LIAsound: el proyecto valenciano que enseña a escuchar a la inteligencia artificial

La iniciativa impulsada por el ITI crea una base de datos con sonidos reales, como el del puerto de la ciudad, para detectar incidencias, anticiparse a emergencias y realizar mantenimiento predictivo de forma remota y precisa

¿Son conscientes de la información que nos puede aportar escuchar por ejemplo un cristal romperse o, todavía más, el ruido de un coche al acercarse? Aunque la imagen, sobre todo a día de hoy, se lleva el protagonismo en la sociedad actual, el sonido tiene un papel crucial en distintos ámbitos de nuestra vida.

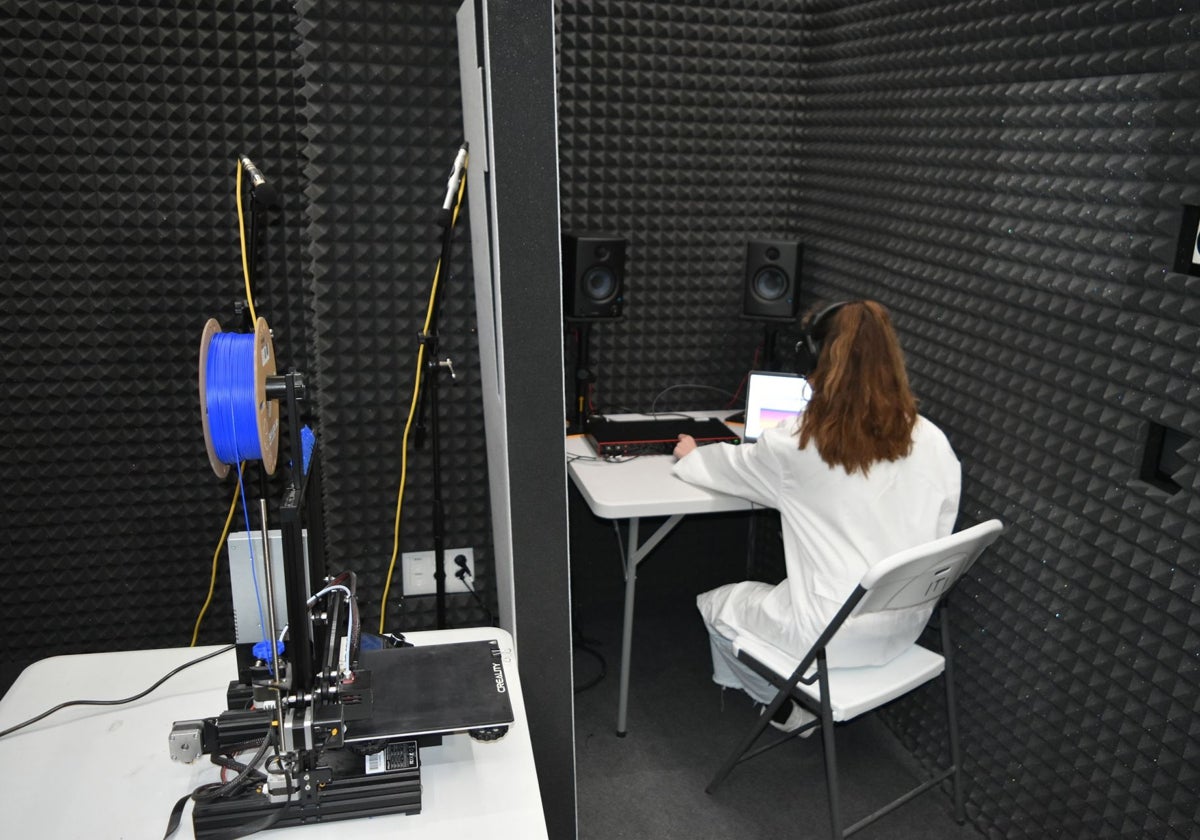

Así lo entiende Pedro Zuccarello, director de la línea de I+D Audio and Neuromorphic Processing de ITI, que en 2021 entró a formar parte del Instituto Tecnológico de Informática de la Universitat Politècnica de Valencia, y que desde aquel momento ha trabajado en una misma dirección que le ha llevado a la creación del proyecto LIASoud que aplica la Inteligencia Artificial (IA) al sonido para detectar incidencias, anticiparse a emergencias y realizar mantenimiento predictivo de forma remota y precisa. «Nuestro grupo de investigación dentro de ITI tiene una línea de trabajo en análisis de sonido mediante inteligencia artificial. Hemos preferido dedicarnos a la parte de sonidos ambientales como los que hay en las ciudades o entornos abiertos y en entornos industriales», explica el experto, dejando de lado de momento, las voces o la música, por ejemplo.

Noticia relacionada

La futbolista internacional que revoluciona el fitness con una aplicación

Zuccarello comenta que hay un cierto «paralelismo» entre el análisis de imágenes mediante IA, sin embargo, el sonido no se ha explorado tanto: «Es un poco, digamos la hermana menor de la imagen desde el punto de vista de los avances en IA, nosotros pensamos que si la percepción auditiva del ser humano para su día a día es importante, ¿por qué no podríamos desarrollar algo parecido a lo que se hace con la imagen, pero con los sonidos?»

El experto detalla algunas aplicaciones prácticas de este análisis del sonido: «En los vehículos autónomos se puede incorporar el análisis de sonido para aumentar la seguridad, ya que éste nos aportar mucha información; ahora estamos trabajando con el puerto de Valencia realizando análisis de sonidos en el entorno portuario, otra aplicación es la seguridad en las casas o locales». Otra aplicación está relacionada con el mantenimiento predictivo que permitiría detectar fallos en la maquinaria según los sonidos que emite: «Las máquinas cuando se van a romper suelen empezar a hacer un ruido particular.»

Por lo tanto, LIAsound permitirá mejorar el control, la seguridad, la logística y la eficiencia en instalaciones como fábricas, puertos o infraestructuras en construcción, mediante el reconocimiento automático de sonidos característicos de cada entorno.

«Pensamos que si la percepción auditiva del ser humano para su día a día es importante, ¿por qué no podríamos desarrollar algo parecido a lo que se hace con la imagen, pero con los sonidos?»

Pedro Zuccarello

Una de las características de este proyecto con adn valenciano es la integración de IA neuromórfica, una tecnología inspirada en el comportamiento del cerebro humano. «A diferencia de los modelos de IA tradicionales, los sistemas neuromórficos imitan la forma en que las neuronas procesan la información, lo que permite una reducción considerable del consumo energético, menor latencia (es decir, respuestas más rápidas) y una mejor gestión del ancho de banda», incide.

Los motivos por los que la ia en el sonido no se ha aplicado de manera tan extensa como en la imagen suponen algunos retos para el sector: «Para trabajar en IA hacen falta datos y no hay bases de datos tan extensas por eso estamos tomando muestras de lugares como el Puerto, para que se entienda, por ejemplo, nadie sube a una red social el audio de la puerta de su coche cerrándose, sube una imagen del coche en silencio».

De hecho, en los próximos pasos en el desarrollo de LIAsound está crear una «base de datos propia para poder desarrollar y entrenar modelos propios». «Queremos demostrar el potencial de aplicar esta tecnología a la industria y llegar allí donde todavía no lo ha hecho», concluye.

¿Tienes una suscripción? Inicia sesión